Künstliche Intelligenz, Halbleiter und das Militär

Verfahren aus dem Bereich der Künstlichen Intelligenz (KI) haben in den vergangenen Jahren einen enormen Entwicklungsschub erfahren, der insbesondere durch globale Tech-Unternehmen und Forschungseinrichtungen vorangetrieben wird. Gleichzeitig demonstriert der Einsatz dieser Dual-Use-Technologie in der Gefechtsfeldsteuerung und Datenanalyse in der Ukraine oder zur großflächigen Auswahl militärisch relevanter Ziele in Gaza exemplarisch die Relevanz, die diese Technologie zunehmend auch für militärische Akteure entwickelt. Diese Anwendungen verdeutlichen jedoch auch die Herausforderungen dieser Technologie hinsichtlich der Grenzen menschlicher Kontrolle und der Nachvollziehbarkeit von automatischen Entscheidungen und unterstreichen die Notwendigkeit einer Regulierung. Parallel dazu entwickelt sich die Dominanz über KI- und Halbleitertechnologien sowie die Verfügbarkeit der zugrunde liegenden Produktionsketten zunehmend zu einem globalen Power-Play.

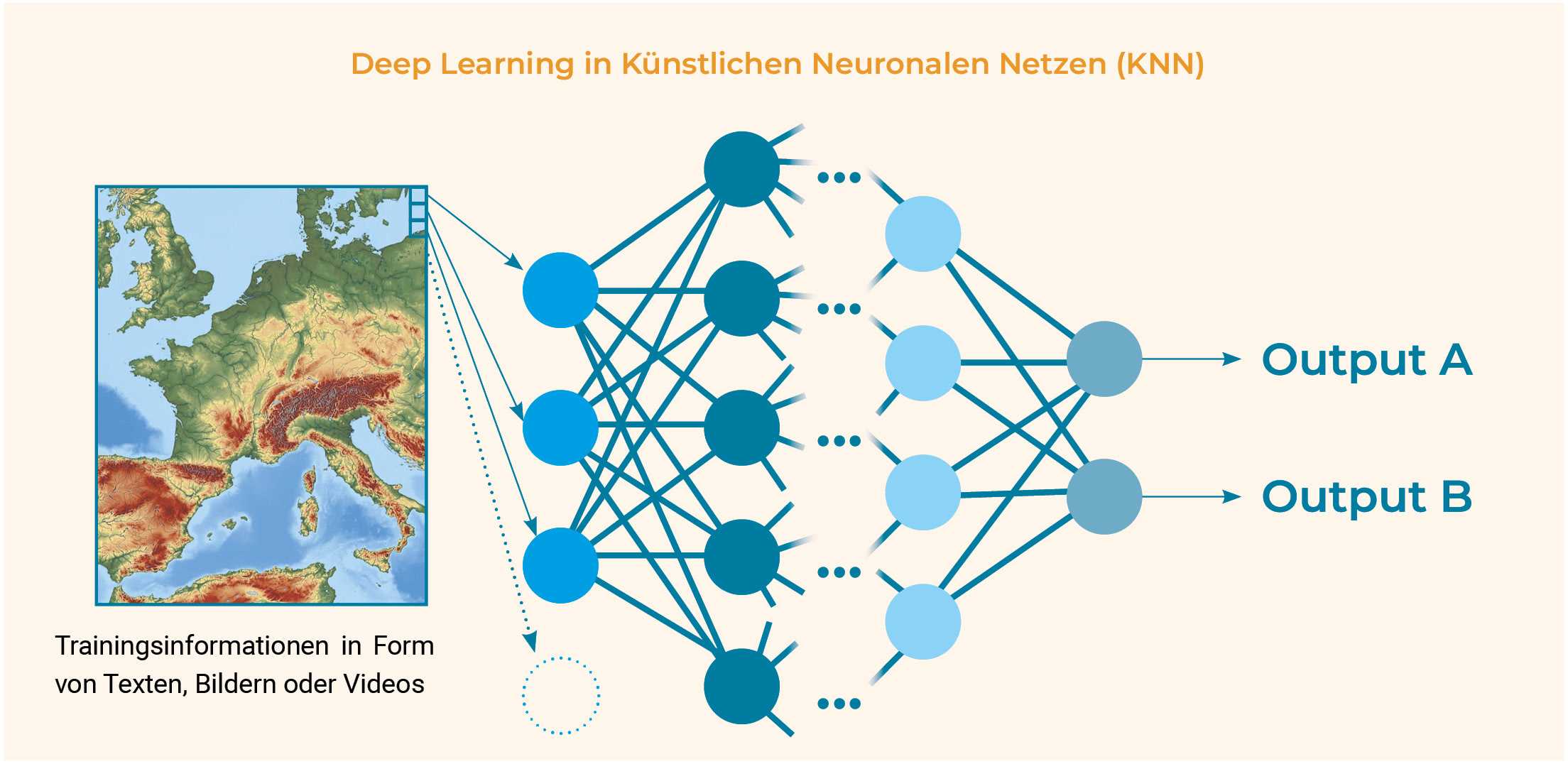

Obgleich und das darin enthaltene Teilgebiet des eine große Bandbreite von Ansätzen abdeckt, basieren die aktuellen KI-Systeme nahezu ausschließlich auf dem Konzept der sogenannten . Bei diesem Ansatz, der auf Ideen aus den 1940er Jahren basiert, werden die Funktion und Vernetzung menschlicher Gehirnzellen nachempfunden. Obgleich in den 1980ern und 1990ern bereits umfangreich erforscht, haben erst aktuelle Halbleitertechnologien und die Herstellung hochgradig leistungsstarker, günstiger und kleiner Chips die Leistungsfähigkeit erreicht, die in Verbindung mit effizienteren Softwarearchitekturen moderne KI-Anwendungen ermöglichen. Weitere Ansätze wie , und spielen zwar in spezifischen Anwendungen eine Rolle, in öffentlichen Debatten bezieht sich der Begriff KI aber in aller Regel auf KNN.

Kernstück einer KI-Anwendung ist das sogenannte , eine Datenstruktur zum Speichern digitaler Informationen. Dieses wird mithilfe umfangreicher Daten, die auf die zu erzielende Problemlösungsfähigkeit zugeschnitten sind, in einem sogenannten aufgebaut. In der Regel handelt es sich hier um das sogenannte Deep Learning (DL). Modelle sind dabei entweder auf eine konkrete Aufgabe zugeschnitten oder in Form oft kommerziell vermarkteter Foundation-Modelle vortrainiert, die in weiteren Trainingsprozessen mit spezifischen Daten auf den eigentlichen Anwendungskontext optimiert werden. Die Qualität und Verfügbarkeit von Trainingsdaten ist dabei entscheidend für die erzielbare Problemlösungsfähigkeit der KI, weshalb diese oft durch spezialisierte Unternehmen zusammengestellt, von Hand kuratiert und entsprechend am Markt als wirtschaftliches Gut angeboten werden. Aktuelle KI-Generationen unterscheiden sich hinsichtlich der Form der Daten, die im Training sowie während der Anwendung verarbeitet und für die Nutzerinteraktion eingesetzt werden können. Während sich diese Differenzierung jedoch zunehmend auflöst, arbeiten die weltweit führenden KI-Unternehmen wie OpenAI, Meta, Microsoft oder Anthropic an einer sogenannten „Künstlichen allgemeinen Intelligenz“ (AGI – Artificial General Intelligence). Diese soll menschenähnliche kognitive Fähigkeiten aufweisen und damit beispielsweise in der Lage sein, aus Erfahrungen zu lernen, Schlussfolgerungen selbstständig zu korrigieren oder mit anderen KI-Systemen zu interagieren. Wann und ob dieses ambitionierte Ziel überhaupt erreicht werden kann, ist aber in Expert*innen-Kreisen umstritten.1

All diese KI-Systeme benötigen enorme Rechenleistungen, um trainiert und in einer fertigen Anwendung ausgeführt zu werden. Im Kontrast zu Cloud-Server-Zentren ist das nur mit sehr viel rechenstärkeren Chips möglich, die auch über längere Zeit unter Volllast betrieben werden können. Die neueste Generation von KI-Beschleunigern (die sogenannte GB200-Architektur) des Marktführers Nvidia, die einen KI-Chip () und weitere notwendige Hardware kombiniert, hat beispielsweise eine Leistungsaufnahme von rund 1500 Watt pro Geräteeinheit, bei einer dauerhaften Rechenleistung von 45 * 10¹² Billionen Operationen pro Sekunde.2 Zum Vergleich: Ein iPhone 14 schafft in kurzen Lastspitzen ca. 1,4 * 10¹² Operationen pro Sekunde.3 KI-Rechenzentren, in denen Zehn- bis Hunderttausende dieser Geräte gemeinsam betrieben werden, erreichen so Gesamtleistungsaufnahmen von 100 Megawatt und mehr.4 Da solche Server-Systeme mit den notwendigen Netzwerk-Infrastrukturen für den internen Datenaustausch sowie für die Stromversorgung und die enorm aufwendige Kühlung der Anlagen ausgestattet werden müssen, sind die Herstellung dieser technischen Anlagen, deren Aufbau und Betrieb enorm kostspielig.5

Militärische KI-Anwendungen

Der Einsatz von KI im Kampf der Ukraine gegen Russland oder im Krieg Israels gegen die Hamas haben die Dynamiken der Einführung von neuen Technologien mit Dual-Use-Potenzial in militärische Anwendungen verdeutlicht. Im ersten Fall sind KI-Anwendungen eher aus der Situation heraus entstanden und werden ad hoc in militärische Prozesse eingebettet und de facto im Feld getestet, angepasst und ausgebaut. Am Beispiel Israels wird dagegen die langfristige strategische Einbettung solcher Anwendungen in militärische Entscheidungsabläufe, verbunden mit dem notwendigen logistischen und technischen Strukturaufbau, deutlich. Beiden Kriegen ist gemein, dass KI-Systeme darin überwiegend als Hilfsmittel in der taktischen Planung eingesetzt werden, um die Entscheidungsfindung durch die automatisierte Aggregation und Auswertung unterschiedlichster Datenquellen zu unterstützen und zu beschleunigen – sogenannter Decision-Support- bzw. Battlefield-Management-Systeme. Während in der Ukraine damit beispielsweise Truppenbewegungen vorhergesagt werden, sind im Zuge des Gaza-Krieges die israelischen Systeme „Lavender“6 und „Gospel“7 bekannt geworden, die eingesetzt werden, um physische Objekte aber auch Personen zu identifizieren und als potenziell relevante militärische Ziele zu markieren. Diese Anwendung von KI kann als nächster Schritt nach dem als Big Data bekannt gewordenen Ansatz verstanden werden, die umfangreichen Daten aus moderner militärischer Sensorik wie Bild- und Videodaten, aber auch Bewegungsprofile von Zielen zusammenzuführen und durch technische Unterstützung aufzubereiten.8 Diese, aus militärischer Perspektive als taktischer Vorteil verstandene, Verringerung der sogenannten Sensor-to-Shooter-Zeitspanne9 erhöht dabei die Geschwindigkeit der Kriegsführung weiter, während die Rolle der menschlichen Kontrolle und Eingriffsmöglichkeiten weiter zurückgedrängt und letztere zunehmend als Nadelöhr wahrgenommen werden.10

Auch der Trend zu Autonomisierung militärischer Waffensysteme befeuert die Entwicklung und den Einsatz von KI. Solche Systeme sollen zum einen entweder in unbekanntem Gebiet oder unter variablen Bedingungen operieren und benötigen im Gegensatz zu starren Anweisungen die Möglichkeit, flexibel auf Situationen zu reagieren. KI-Systeme ermöglichen diese Fähigkeiten, die beispielsweise darin bestehen können, autonom in einem Zielgebiet zu operieren und dabei Hindernisse zu berücksichtigen oder militärische Ziele auch bei verrauschten Datenquellen zu identifizieren. Zum anderen sind KI-Systeme in der Lage, im Trainingsprozess selbständig Muster zu erfassen oder Regeln aus Datenmaterial abzuleiten. Dadurch können KI-Systeme hochkomplexe Fähigkeiten wie die Steuerung und den Luftkampf von Kampfjets erlernen,11 ohne dass diese explizit formuliert werden müssen. Technologisch kommt hierbei zum Tragen, dass unterschiedliche KI-Systeme auch gekoppelt betrieben werden können. So können beispielsweise die Auswertung von Radardaten, die Identifikation von potenziellen Zielen oder die Navigation eines Fahrzeuges durch einzelne KI-Systeme realisiert werden und deren Ausgaben dann in einer übergreifenden KI für die Gesamtsteuerung zusammengeführt werden.

Neben diesen komplexen Anwendungen von KI sind einige spezielle Fähigkeiten mittlerweile technologisch derart ausgereift – wie die Bildauswertung oder die Sprachanalyse, die mittlerweile in jedem modernen Smartphone als Chips verbaut sind –, dass auch militärische Kleingeräte wie Quadrocopter damit massenhaft günstig versehen und entsprechend verbessert werden können. Dieses „Ausrollen in der Breite“ ermöglicht damit Anwendungen, wie sie beispielsweise im US-Programm „Replicator“12 umgesetzt werden sollen, das den großflächigen, automatisierten und autonomisierten Einsatz von Drohnenschwärmen vorsieht – eine Idee, die unlängst auch im Rahmen der NATO zur Grenzsicherung gegenüber Russland diskutiert worden ist.13

Auch im Cyberspace spielt KI eine zunehmende Rolle, beispielsweise bei der automatisierten Auswertung der Datentransfers, um ungewöhnliche Aktivitäten zu identifizieren, die auf Cyberattacken schließen lassen, um Schadsoftware zu entdecken oder auch um automatisiert Gegenmaßnahmen auszulösen.14 Gleichzeitig kann KI aber auch eingesetzt werden, um auf Grundlage verfügbarer Datenbanken von Sicherheitslücken neue Schadsoftware automatisiert zu erzeugen oder auf ausgewählte Ziele zuzuschneiden.15

Diese Fähigkeit von KI, neue Varianten eines digitalisierten Datensatzes auf Grundlage bestehender Informationen zu generieren, wird mit Blick auf die Herstellung neuer Bio- und Chemiewaffen als hochkritisch angesehen.

Hinsichtlich der Analyse von Bild- und Sensordaten wird KI immer wieder auch im Rahmen der nuklearen Abschreckung und der dafür notwendigen Überwachungs- und Sensorinfrastrukturen diskutiert. Da insbesondere für diesen Einsatz die Reaktionsgeschwindigkeit bei einem hypothetischen nuklearen Angriff als entscheidend betrachtet wird, sollen KI-Systeme hier für die Erkennung nuklearer Angriffsvorbereitungen und Aktivitäten eingesetzt werden.16 Gleichzeitig verdeutlicht dieses Szenario die Gefahr der „Eskalation aus Versehen“ und die Unabwägbarkeiten beim Einsatz einer schwer kontrollierbaren oder nachvollziehbaren Technologie, selbst wenn diese „nur“ zur Filterung und Analyse von Daten dient.

Zusammengefasst wird KI seitens militärischer Akteure als „Enabling“-Technologie aufgefasst, die bestehende Anwendungen optimiert oder die operative Ausweitung in bestimmten Einsatzszenarien ermöglicht. Eine wesentliche Motivation besteht dabei darin, taktische Vorteile durch die Beschleunigung von Entscheidungsprozessen sowie Informationsvorteile zu erlangen. In Verbindung mit autonomen Waffensystemen spielen darüber hinaus auch Überlegungen eine Rolle, die Gefahr eigener menschlicher Verluste durch den Einsatz technischer Geräte zu verringern. KI wird darüber hinaus als Lösung angesehen für ein immanentes Problem der zunehmenden Technisierung der Streitkräfte, nämlich dass immer bessere Waffen- und Sensortechnik in aller Regel auch immer größere Datenmengen erzeugen, die kaum mehr durch menschliche Operateure handhabbar sind.

Zusammengefasst wird KI seitens militärischer Akteure als „Enabling“-Technologie aufgefasst, die bestehende Anwendungen optimiert oder die operative Ausweitung in bestimmten Einsatzszenarien ermöglicht.

Ausblick und Empfehlungen

Angesichts des rasanten Fortschritts von KI-Technologie debattieren Staaten gegenwärtig in unterschiedlichen Formaten und oft in enger Kooperation mit Vertreter*innen der KI-Tech-Unternehmen, wie ein verantwortungsvoller Umgang mit KI aussehen kann und welche Form der Regulation dafür notwendig wäre.17 Insbesondere für die militärische Anwendung sollten sich diese Debatten dabei unmittelbar an den Fragen orientieren, wie sie bereits im Kontext autonomer Waffensysteme seit langem gestellt werden, etwa nach den Möglichkeiten menschlicher Kontrolle und Verantwortlichkeit sowie Vereinbarkeit solcher Systeme mit dem Völkerrecht, aber auch nach Gefahren für die militärische Stabilität zwischen möglichen Gegnern. Gleichzeitig darf dabei nicht außer Acht gelassen werden, dass selbst bei einer KI-gestützten Anwendung, deren finale Entscheidung durch einen menschlichen Operator getroffen wird, die KI selbst durch Filter- und Analyseprozesse unzählige Mikro-Entscheidungen getroffen hat, die weder im Trainingsprozess explizit und nachvollziehbar definiert worden sind noch dem Operator in der Situation der Entscheidung transparent sind.18 Auch wenn erste Ansätze der sogenannten „Erklärbaren KI“ ()19 versuchen, diesen Black-Box-Charakter einer KI aufzulösen, so reichen diese bei weitem nicht an die benötigte Erklärbarkeit heran, wie sie menschliche Schlussfolgerungsprozesse bieten. Darüber hinaus führen diese Ansätze in aller Regel zu einer Reduktion der Leistungsfähigkeit und Reaktionsgeschwindigkeit einer KI, also den Hauptvorteilen dieser Technologie, und werden sich ohne verbindliche rechtliche Vorgaben kaum durchsetzen können.

Erste staatliche Vorstöße bei der Regulierung militärischer KI lassen aber auch Divergenzen hervortreten, insbesondere zwischen Staaten, die Teil der extrem zentralisierten KI-Produktionsketten sind, wie die USA, UK, die Niederlande und Taiwan, und Staaten, die daran aktuell nicht partizipieren, allen voran China. Angesichts der starken Zentralisierung und der globalen Abhängigkeit von Halbleiterfertigungsbetrieben in Taiwan wie TSMC (sogenannte Foundries) verstärkt diese Entwicklung allerdings auch die Sorge vor zunehmenden internationalen Spannungen. Dies wird in besonderem Maße in Form der „Chip Wars“ deutlich, mit denen die USA einerseits versuchen, chinesische Hersteller vom Zugriff auf spezialisierte KI-Chips und das dafür benötigte Know-how, die Herstellungsgeräte, Materialien und Produktionsketten abzuhalten20 und andererseits durch spezielle Mechanismen wie Kill-Switches in Chip-Herstellungsanlagen21 – die im Bedarfsfall die Geräte zerstören würden – ihren Verbündeten Taiwan vor dem chinesischen Hoheitsanspruch zu schützen.

Unabhängig von der individuellen Bewertung dieser Maßnahmen demonstrieren die USA aber auch, dass es durchaus Ansatzmöglichkeiten für die Regulierung von KI-Systemen gibt. So definiert die „Executive Order on Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence“ (Executive Order 14110 von 2023) technisch messbare Parameter, wie die für das Training oder die Ausführung eines KI-System benötigte Gesamtrechenleistung, als Grundlage für die US-Exportkontrolle solcher Geräte und fertiger KI-Produkte. Angesichts dieser Ansatzpunkte, verbunden mit dem Aspekt, dass es trotz des digitalen Charakters von KI-Anwendungen vor allem die spezialisierten Server- und Netzwerkgeräte sind, die leistungsfähige KI-Systeme ermöglichen, bestehen für die Rüstungskontrolle vielleicht noch Chancen. Dafür müssten auch andere Staaten diese Impulse aufgreifen, weiterentwickeln und unterstützen.

- Fjelland, R. (2020). Why general artificial intelligence will not be realized. Humanities and Social Sciences Communications, 7(1), 10. https://doi.org/10.1057/s41599-020-0494-4 ↩

- Spille, C. (2024, 18. März). Blackwell: Nvidia enthüllt seine nächste KI-Beschleuniger-Generation. heise online. https://www.heise.de/news/Nvidias-neue-KI-Chips-Blackwell-GB200-und-schnelles-NVLink-9658475.html ↩

- Owen, M. (2022, 26. September). How iPhone speeds have grown in the last 5 years. appleinsider. https://appleinsider.com/articles/22/09/26/how-iphone-speeds-have-grown-in-the-last-5-years ↩

- Patel, D., & Nishball, D. (2024, 17. Juni). 100k H100 Clusters: Power, Network Topology, Ethernet vs InfiniBand, Reliability, Failures, Checkpointing. SemiAnalysis. https://www.semianalysis.com/p/100000-h100-clusters-power-network ↩

- Patel & Nishball, 2024. ↩

- Abraham, Y. (2024, 3. April). ‘Lavender’: The AI machine directing Israel’s bombing spree in Gaza. 972 Magazine. https://www.972mag.com/lavender-ai-israeli-army-gaza/ ↩

- Davies, H., McKernan, B., & Sabbagh, D. (2023, 1. Dezember). ‘The Gospel’: How Israel uses AI to select bombing targets in Gaza. The Guardian. https://www.theguardian.com/world/2023/dec/01/the-gospel-how-israel-uses-ai-to-select-bombing-targets ↩

- RAFAEL Advanced Defense Systems LTD. (2019). FIRE WEAVER - Tactical Networked Sensor-to-Shooter System. https://www.rafael.co.il/system/fireweaver/ ↩

- Skove, S. (2024, 7. März). Targeting time shrinks from minutes to seconds in Army experiment. DefenseOne. https://www.defenseone.com/threats/2024/03/targeting-time-shrinks-minutes-seconds-army-experiment/394758/ ↩

- Deutscher Ethikrat. (2023). Mensch und Maschine – Herausforderungen durch Künstliche Intelligenz—Stellungnahme des Deutschen Ethikrates. https://www.ethikrat.org/fileadmin/Publikationen/Stellungnahmen/deutsch/stellungnahme-mensch-und-maschine.pdf ↩

- Copp, T. (2024, 5. April). An AI-controlled fighter jet took the Air Force leader for a historic ride. What that means for war. Politico. https://www.politico.com/news/2024/05/04/an-ai-controlled-fighter-jet-took-the-air-force-leader-for-a-historic-ride-what-that-means-for-war-00156147 ↩

- Katz, J. (2024, 20. Januar). Replicator’s ‘PRIME’ time: DIU seeks small USV interceptors ready for rapid production. Breaking Defense. https://breakingdefense.com/2024/01/replicators-prime-time-diu-seeks-small-usv-interceptors-ready-for-rapid-production/ ↩

- Milne, R. (2024). Six Nato countries plan ‘drone wall’ to defend borders with Russia. Financial Times. https://www.ft.com/content/949db465-cd27-4c66-9908-c2faa80b602b ↩

- Jun, J. (2024, 30. April). How Will AI Change Cyber Operations?. War on the Rocks. https://warontherocks.com/2024/04/how-will-ai-change-cyber-operations ↩

- Fang, R., Bindu, R., Gupta, A., Zhan, Q., & Kang, D. (2024, 2. Juni). Teams of LLM Agents can Exploit Zero-Day Vulnerabilities (arXiv:2406.01637). arXiv. http://arxiv.org/abs/2406.01637 ↩

- Topychkanov, P. (2019, Mai). The Impact of Artificial Intelligence on Strategic Stability and Nuclear Risk. In South Asian Perspectives (Band 1). SIPRI. https://www.sipri.org/publications/2019/research-reports/impact-artificial-intelligence-strategic-stability-and-nuclear-risk-volume-i-euro-atlantic ↩

- Reinhold, T. (2024, 7. Mai). Der militärische Einsatz künstlicher Intelligenz braucht Regeln: Nur welche, darüber besteht keine Einigkeit. PRIF Blog. https://blog.prif.org/2024/05/07/der-militaerische-einsatz-kuenstlicher-intelligenz-braucht-regeln-nur-welche-darueber-besteht-keine-einigkeit ↩

- Heaven, W. D. (2024, 4. März). Large language models can do jaw-dropping things. But nobody knows exactly why. MIT Technology Review. https://www.technologyreview.com/2024/03/04/1089403/large-language-models-amazing-but-nobody-knows-why/ ↩

- Barredo Arrieta, A., Díaz-Rodríguez, N., Del Ser, J., Bennetot, A., Tabik, S., Barbado, A., Garcia, S., Gil-Lopez, S., Molina, D., Benjamins, R., Chatila, R., & Herrera, F. (2020). Explainable Artificial Intelligence (XAI): Concepts, taxonomies, opportunities and challenges toward responsible AI. Information Fusion, 58, 82–115. https://doi.org/10.1016/j.inffus.2019.12.012 ↩

- Shepardson, D., & Nellis, S. (2024, 8. Mai). Intel, Qualcomm say exports to China blocked as Beijing objects. Reuters. https://www.reuters.com/technology/intel-flags-revenue-hit-us-revokes-certain-export-licenses-chinese-customer-2024-05-08 ↩

- Bloomberg. (2024, 22. Mai). ASML and TSMC can disable EUV machines. Taipei Times. https://www.taipeitimes.com/News/biz/archives/2024/05/22/2003818194 ↩